-

Xでシェア

-

Facebookでシェア

-

LINEでシェア

-

LinkedInでシェア

-

記事をクリップ

-

記事を印刷

採用候補者は、AIに評価されるため自己を歪曲する

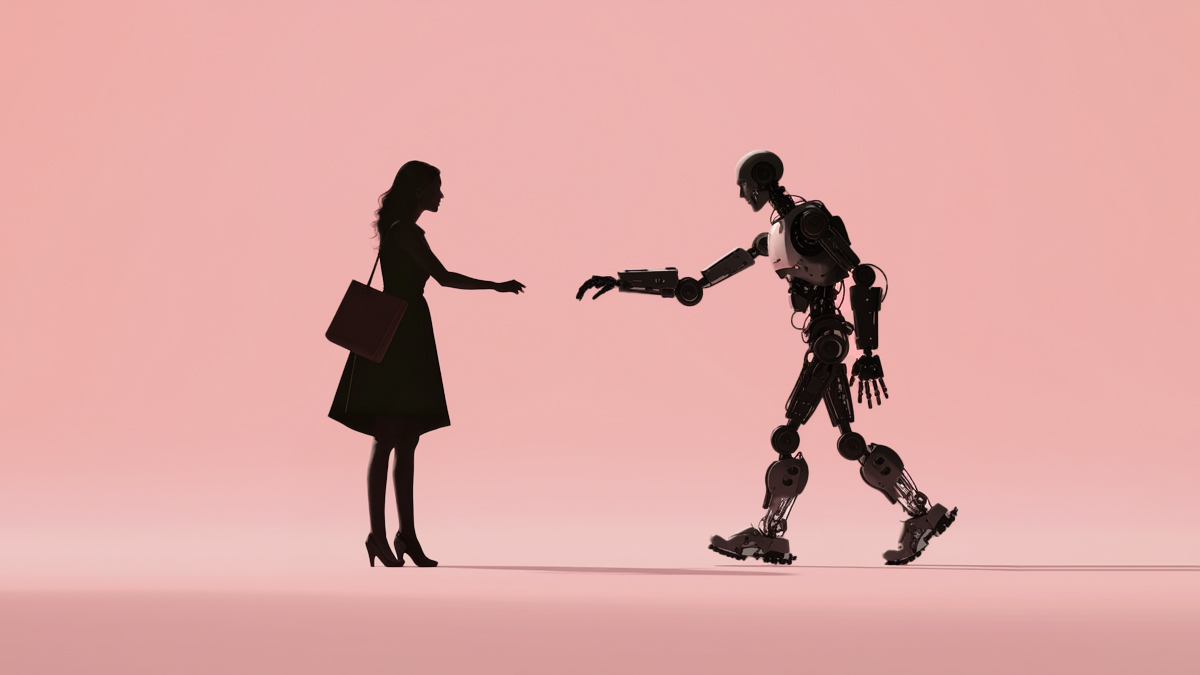

世界経済フォーラムによれば、雇用主の90%以上は求人への応募書類のふるい分けやランクづけに自動システムを利用し、企業の88%は一次選考に何らかの形でAIをすでに導入しているという。ユニリーバの事例を考えてみよう。この巨大消費財企業は、ハイアービューのAI駆動型ツールを用いてキャリア初期の応募者を審査し、その過程で5万時間、100万ドル以上を節約している。

ほとんどの企業はAI審査ツールの導入を検討する際、効率性と精度の観点からメリットに焦点を当てる。しかし、AIで審査することによって、審査中の候補者の行動がどのように変わる可能性があるのかについては考慮しない。

筆者らの新たな研究は、12の調査を通じて1万3000人以上の参加者を検証し、これが重大な盲点であることを明らかにしている。我々は実験室と現場の両方でさまざまな審査場面のシミュレーションを観察し、ゲームベースの採用ソリューションを提供するスタートアップのプラットフォームであるイクアルチャーと協働した。

その結果、採用候補者は、自分がAIによって評価されていると信じている時には、一貫して分析的な資質を強調した。一方、共感力や創造性、直観力といった極めて人間らしい特性は控えめに示した。これらは往々にして、能力が高いだけの従業員と、卓越した従業員を分かつ特性だ。

このため候補者は、本来の自分とは異なり、かつ潜在的に他者と似通った自己像をアピールするようになったのである。この傾向は、AIを活用した採用プロセスで誰が合格しやすいのかを左右し、採用や昇進、入学選考の判断にAIを利用する組織にも影響を及ぼす。

組織にとって、これはなぜ問題なのか

筆者らの研究結果は、個々の採用判断に関してのみならず、より広い意味合いを持つ。候補者が体系的に自己を歪曲してアピールすると、組織はいくつかの深刻な課題に直面する。

・人材プールの歪み:AIは偏った採用判断を行うとして非難されることがある(選考過程で女性を差別するなど)。しかし筆者らの研究によれば、候補者もまた自分がAIに審査されていると知ることでバイアスを持ち、分析的能力を優先的に示すべきだと思い込んでしまう。

結果的に、企業はAIを用いることで、まさに必要としている候補者をふるい落としている可能性がある。自社が求めている革新的な考え方の持ち主や、感情的知性(EI)が高いリーダーは、「ルールに従う分析家」として自分をアピールするかもしれない。AIがそれを求めている、と彼らは信じるからだ。

・有効性の低下:審査ツールは収集するデータの質に左右される。候補者が戦略的に回答を変えると、審査プロセスの根本的な有効性が損なわれかねない。組織が測定するのはもはや候補者の本当の能力ではなく、候補者が考える「AIが最も重視するであろう能力」かもしれない。

・意図せぬ同質化:「AIは分析的資質を優遇する」と大半の候補者が思い込んでいる場合、人材パイプラインは画一化が進み、ダイバーシティの取り組みが妨げられ、組織における視点の幅が制限される可能性がある。採用と内部昇進のどちらにもAIを取り入れているIBMやヒルトンのような企業はいまや、それらのツールが従業員の型にはまった自己アピールを促していないか検証しなければならない。

EUのAI規制法のように、重大な意思決定におけるAIの使用を開示するよう組織に義務づける新たな透明性の規制によって、これらの結果が生じる可能性はいっそう高まる。候補者は自分がAIで審査されていると認識している時、行動を変える傾向が強いのだ。

リーダーにできること

筆者らの研究結果を踏まえ、組織はAI審査の影響に対処するために、いくつかの具体的な措置を講じることができる。

1. 徹底的な透明性

AI審査を実施していることを開示するだけでなく、AIが実際に何を評価するのかについて明示する。創造性やEI、直観的な問題解決能力などを含め、自社のAIはさまざまな資質の評価が可能であり、実際に評価する、という事実を明確に伝えるべきだ。これには、優れた直観力や創造性を発揮して合格した候補者の例を提示することも含まれるかもしれない。

現在、AIが実際に何を審査するのかを開示している企業はほとんどないように思われる。少なくとも、多くの大企業のウェブサイトで採用ページの情報を見て回っても、その情報は容易に入手できない。

ただし、応募者は自身の洞察をブログや動画で語り共有しているが、これは実際の手法と一致しているかどうかが不明なため、逆効果となりかねない。企業は候補者の憶測に任せておくべきではない。

2. 定期的な行動監査

AI審査の結果について、体系的な検証を実施する。たとえばニューヨーク市は、AIを利用した採用におけるバイアスの監査を毎年実施するよう雇用主に義務づける「現地法144」を制定した。これを受け、AIベースの採用におけるマーケットリーダーの一社であるハイアービューは、職種とユースケースごとに人種やジェンダーのバイアスを調査した最近の監査結果を公表している。

人口統計的属性に関するバイアスの検証に加え、この監査を利用して、行動適応の傾向を探ることを筆者らは推奨する。候補者の回答は、時とともにより同質的になっていないだろうか。他の貴重な資質を犠牲にして、分析的な自己アピールへとシフトする傾向が見られないだろうか。

3. ハイブリッド審査

一部の組織は人間とAIによる審査を組み合わせている。例としてセールスフォースは、テクノロジーだけでなく人間も応募書類に目を通すことを明記している。エヌビディアとフィリップモリス・インターナショナルは、最終的な審査と決定が人間によって行われることを保証している。

筆者らの調査の一つでは、人間も加わるこのハイブリッド審査によって、候補者が分析的能力を強調する傾向は軽減されるものの、完全にはなくならないことが示されている。このギャップを埋めるには、企業はAIの影響を相殺できるよう人間の採用担当者を訓練する必要がある。

進むべき道

AIが組織の意思決定にますます組み込まれていく中、これらのツールはプロセスを変えるだけでなく、人間も変容させることを私たちは認識しなければならない。AI審査による効率性の向上は、候補者の正直な自己アピールを犠牲にして生じるのかもしれず、最終的には組織の革新性とレジリエンスを高める人的多様性を損なうおそれがある。

これは驚くべき皮肉だ。私たちは採用における人間のバイアスを排除しようと努める過程で、AIによって新たな形のバイアスが生まれるシステムをつくり出してしまったのかもしれない。

解決策はAIの廃止ではなく、このような行動変容を考慮して防ぐ審査システムを設計することである。指標だけでなく人間を審査戦略の中心に据え続けることでのみ、組織が必要とする多様な人材を真に見極めて育てる採用システムの構築が可能となるのだ。

"How AI Assessment Tools Affect Job Candidates' Behavior," HBR.org, July 14, 2025.

![H.ミンツバーグ経営論[増補版]](https://dhbr2.ismcdn.jp/mwimgs/8/7/135w/img_871cd4da49e5d4f957c01d18842ab79034921.jpg)