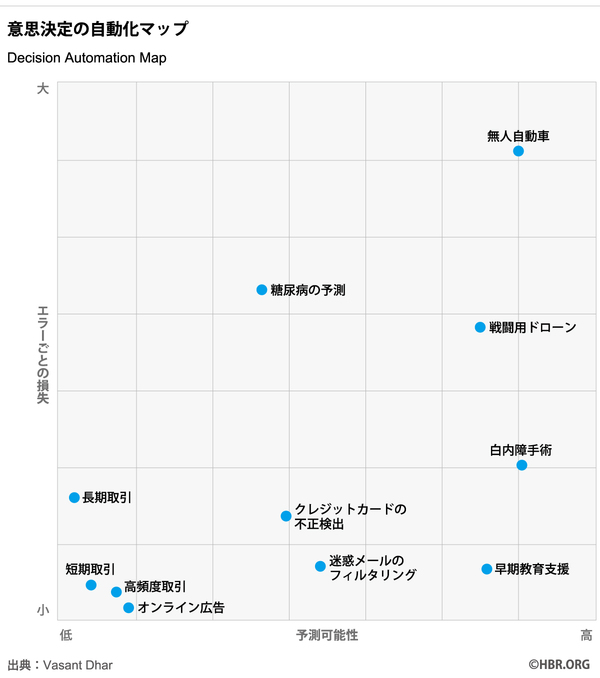

だが、それだけでは分析は片手落ちだ。意思決定をロボットに任せてよいか否かを正しく見極めるには、誤りが生じた場合の影響について考えなければならない。これは、予測精度と少なくとも同等か、おそらくそれ以上に重要な要素である。

2軸の図(以降、DAマップと呼ぶ)では、横軸は前出の図と同じく予測可能性を示している。縦軸は「エラーごとの損失」で、これは課題の種類に応じて金額やその他の単位で測られる。この2つ目の側面を加えることで、重要な気づきが新たにもたらされる。

先に言及した、予測可能性が比較的高い2つの課題、迷惑メールのフィルタリングと無人自動車について考えてみよう。前者はややこしい「対敵性」の課題で、迷惑メールの送り手はフィルターを欺こうとし、フィルターはまともなメールをブロックしないように調整されている。だが誤検出による損失はきわめて小さく、いくつかの迷惑メールがフィルターを通過した場合の損失も小さい。

対照的に、無人自動車が判断を誤った場合の損失は膨大になりうる。戦闘用ドローン(図の中段右寄り)の誤判断による損失もまた、たしかに高い(軍事施設ではなく病院への誤爆など)。だがこれは、無人自動車とは少なくとも2つの点で異なる。ドローンが用いられる戦場では、都市郊外の道路上と比べ、「過誤への許容度」が大きい。そしてドローンを用いることで、パイロットが敵地上空を飛行するという大きなリスクが軽減される。

医療における予測の誤りも、多大な損失につながりうる。たとえば糖尿病の検出漏れは、足の切断などの深刻な結果を招く可能性もある。反対に誤検出の場合には、まったく必要のない薬の処方や検査が実施されるかもしれない。

このDAマップにおける各課題の位置は当然ながら、技術や社会の変化に応じて変わっていく。

データの増加とアルゴリズムの進化によって予測能力が向上すると、課題の位置は右へとシフトする(「未来のDAマップ」図内の右矢印)。また、規制による足かせが増えてエラーごとの損失が大きくなる課題は、上方向へとシフトする(上矢印)。そして規制の緩和や責任の軽減がなされる課題は、下に向かっていく(下矢印)。なお、社会の規範や価値観に変化が生じた場合にもマップは変わる。たとえば、ドローン戦に対する大衆の支持がなくなった場合などだ。

![H.ミンツバーグ経営論[増補版]](https://dhbr2.ismcdn.jp/mwimgs/8/7/135w/img_871cd4da49e5d4f957c01d18842ab79034921.jpg)